Triage: Wenn Mediziner entscheiden, welcher von mehreren Patienten im letzten freien Bett auf der Intensivstation behandelt wird, spielen ethische Aspekte eine Rolle. Eine schwerwiegende Entscheidung – schwerer als die Verantwortung, die Ingenieure üblicherweise zu tragen haben, selbst in der Medizintechnik. Oder gibt es inzwischen Bereiche, bei denen auch Ingenieure genauer hinschauen müssten als bisher?

Zwei Kandidaten, die da Herausforderungen versprechen, sind Digitalisierung und Künstliche Intelligenz. Sie können Produkte hervorbringen, die binnen kurzer Zeit weitreichende Effekte auslösen. Konkretes Beispiel: Eine KI wurde entwickelt, um aus der Vielzahl möglicher Medikamente für die Krebstherapie diejenigen zu empfehlen, die bei einem bestimmten Patienten den größten Erfolg versprechen. Das System – IBM Watson for Oncology – verbreitete sich sehr schnell und wurde in vielen Krankenhäusern eingesetzt. Doch dann fiel einem Arzt ein Fehler auf. Das System empfahl einen Wirkstoff, der für den Patienten eindeutig kontraindiziert war und zu dessen Tod hätte führen können. Der Mediziner schlug Alarm, der Fehler wurde korrigiert, alle betroffenen Krankenhäuser informiert. Dieser reale Fall zeigt laut Dr. Christian Herzog, „dass sich eine digitale Technologie schnell auf viele Menschen auswirken kann und damit eine besondere ethische Dimension hat.“

Ethical Innovation Hub ging 2020 in Lübeck an den Start

Herzog ist Elektroingenieur – aber nicht nur. Sein Interesse an ethischen Fragen hat ihn zu einem Studium der angewandten Ethik geführt. An der Universität Lübeck leitet er eine Institution, die 2020 an den Start ging: die institutsübergreifende Arbeitsgruppe Ethical Innovation Hub (EIH). Organisatorisch ist der EIH eine Kooperation zwischen dem Institut für Medizinische Elektrotechnik und dem Institut für Medizingeschichte und Wissenschaftsforschung. Das Ziel: ethische Fragen schon in der Ideenfindung für ein Produkt und in den darauf folgenden Entwicklungsstufen mit zu berücksichtigen.

Aber: Ethik. Das ist doch ein Begriff, vor dem man sich ein bisschen fühlt wie das Kind vorm Kirchturm. Man muss den Kopf ziemlich weit in den Nacken legen, um die Dimension auch nur annähernd erfassen zu können. So einen Brocken in den Entwicklungsprozess zu integrieren, dürfte eine riesige Aufgabe werden. Zumal Ethik in der Welt der technischen Entwicklungen bisher keine große Rolle spielt. „Traditionell gab es eher Begleitforschung“, fasst Prof. Sami Haddadin von der Technischen Universität München (TUM) zusammen. Er leitet den Lehrstuhl für Robotik und Systemintelligenz – und macht sich mit zwei Professorinnen ebenfalls stark für die Idee, der Ethik in der Entwicklung mehr Gewicht zu geben.

Begleitforschung heißt: Die Ethik kommt hinterher

Die Begleitforschung habe Ethiker meist in die Rolle gebracht, eine fertige Technologie zu bewerten und gegebenenfalls den mahnenden Zeigefinger zu erheben. Das ist laut Haddadin aber ebenso wenig zielführend wie die umgekehrte Rollenverteilung, bei der die Ethik den Rahmen für die Technik absteckt. Das einzig Sinnvolle: Ethische Fragen müssen Ethiker und Techniker von Anfang an gemeinsam diskutieren.

Was aber auch heißt, dass Unternehmen etwas an die Hand bekommen müssen, um sich dem Thema Ethik systematisch zu nähern. „Dieses Ziel verfolgen wir an der TUM seit etwa zwei Jahren“, sagt Haddadin. „Wir“ sind in diesem Fall außer dem Robotik-Experten auch Prof. Alena Buyx, Medizinethikerin und Direktorin des Instituts für Geschichte und Ethik der Medizin sowie Vorsitzende des deutschen Ethikrates, und die Molekularbiologin und Sozialwissenschaftlerin Prof. Ruth Müller, die an der TUM die Professur Wissenschafts- und Technologiepolitik innehat. Ihr Konzept bezeichnen die drei Wissenschaftler als Embedded Ethics.

Toolboxes sollen die Integration ethischer Fragen erleichtern

Wie genau Ethik in die Entwicklung integriert werden kann, ist noch Gegenstand der Forschung. Die Münchner setzen im Moment auf intensiven Austausch zwischen Technikern, Anwendern und Ethikern und wollen als konkretes Ergebnis so genannte Toolboxes entwickeln: Sammlungen ethischer Aspekte, die bei der Entwicklung bestimmter Produkte zu berücksichtigen sind. „Es wird sicher nicht ein Set von Fragen geben, das für jedes Produkt anwendbar ist“, räumt Haddadin ein. „Ebenso wenig wird eine individuelle Sammlung für jedes Produkt erstellt werden können.“ Daher planen die Forscher, Domänen zu definieren und für diese die relevanten Aspekte zusammenzustellen. Eine Domäne könnten Roboter sein, die in der Chirurgie eingesetzt werden. Oder Assistenzroboter in der Pflege. Oder Diagnosetools.

Die richtigen Fragen zu stellen, ist laut Haddadin ein sehr wichtiger Schritt. „Das geht über die reine Funktionalität hinaus – und es erfordert im Unternehmen eine neue Definition der Prozesse.“ Die Unternehmen hätten laut Haddadin auch Interesse, denn die Bearbeitung ethischer Fragen verbessere Produkte für den Anwender, über die Gebrauchstauglichkeit hinaus. „Und“, so der Forscher weiter, „wenn wir an künstliche Intelligenz denken, ist es vorstellbar, dass wir in nicht allzu ferner Zeit regulatorische Vorgaben dazu haben werden, dass zumindest für Produkte mit einem gewissen Risiko ethische Überlegungen berücksichtigt werden müssen.“ Wenn Mediziner zum Beispiel von einem menschengemachten System Empfehlungen bekommen, die das Gehirn nicht mehr nachvollziehen kann.

In Lübeck sind erste Projekte zur Integration ethischer Fragen in der Entwicklung am Ethical Innovation Hub bereits angelaufen. Daran beteiligen sich Start-ups, KMU und Konzerne. Aber auch wenn laut Herzog davon auszugehen ist, dass jeder Mensch ein ethisches Empfinden hat, wäre eine erprobte systematische Herangehensweise für Unternehmen und Entwicklerteams hilfreich.

Nicht allein die Ingenieure tragen die Verantwortung

Die Sache systematisch anzugehen, heißt für Herzog auch, dass man ethische Fragen nicht allein einer Handvoll Ingenieure aufbürden kann, die mehr oder weniger zufällig an einem Produkt arbeiten. „Wir sprechen vom Prinzip der Partizipation: Alle Gruppen, die von den Folgen einer technischen Erfindung betroffen sein könnten, sollen bei einer weitreichenden Entscheidung beteiligt sein.“

Ein im industriellen Alltag – vorsichtig formuliert – sicherlich gewöhnungsbedürftiger Gedanke. Aber das Institut für Technikfolgenabschätzung in Karlsruhe beschäftigt sich seit Jahren damit, ob es sich für ein Unternehmen lohnt, „weiche“ Ziele zu verfolgen, auf Nachhaltigkeit, Ressourcenschonung oder eben Ethik zu setzen. Laut Herzog sind die Ergebnisse positiv: Damit ließen sich Talente ans Unternehmen binden, und das Marketing könne die Initiativen nutzen, um Produkte anders im Markt zu platzieren. Für eine KI beispielsweise wäre eine Art Ethical-AI-Zertifikat denkbar. Und Herzog sagt: „Ich bin manchmal positiv überrascht, wie wichtig gerade jüngere Ansprechpartner das Thema Ethik nehmen.“

Kann eine Software Kompetenzen eines Mediziners vermitteln?

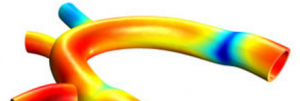

Ein Beispiel dafür ist das Unternehmen Thinksono mit Sitz in London und Potsdam. Die beiden Gründer haben sich vorgenommen, die Diagnose einer relativ weit verbreiteten Krankheit, der tiefen Venenthrombose oder kurz TVT, durch Software zu vereinfachen. „Bisher muss ein Patient mit Verdacht auf so eine Thrombose zum Arzt, der ihn mit Ultraschall untersucht“, erläutert Sven Mischkewitz, der Thinksono mit gegründet hat. „Allerdings müssen Patienten oft lange auf einen Termin warten.“ Eine unentdeckte Thrombose aber kann zu einer lebensbedrohenden Gefäßverstopfung führen. Was aber wäre, wenn man unterstützt von KI-Software die Untersuchung Assistenten oder Pflegekräften übertragen und nur die Auswertung dem Arzt überlassen würde?

Diese Idee wollten die beiden Gründer, der Informatiker Mischkewitz und der Elektroingenieur Fouad Al-Noor, verfolgen und ihr technisches Wissen zum Nutzen der Gesellschaft einsetzen. „Wir haben, um unser Produkt Auto-TVT entwickeln zu können, sehr viel mit Ärzten und Mitarbeitern im Krankenhaus gesprochen“, berichtet Mischkewitz. Dabei ging es oft um Technik und Abläufe, aber auch um Verantwortung. Was bedeutet es für den Arzt, die Untersuchung aus der Hand zu geben? Was heißt es für die Pflegekraft, angeleitet von einer Software eine Ultraschallsonde einzusetzen? Können beide dem Programm vertrauen? Was, wenn eine Unsicherheit auftritt? Wer entscheidet? Wer trägt Verantwortung für die Gesundheit des Patienten?

„Das alles sind ethische Fragen“, sagt Mischkewitz. Darauf, sie zu beantworten, hat ihn das Informatik-Studium nicht vorbereitet. „Letzten Endes mussten wir Techniker aber erkennen, dass es diese Fragen gibt und sie für unser Produkt eine Rolle spielen. Dafür, dass es von den Anwendern genutzt werden kann. Aber auch dafür, dass wir es mit gutem Gewissen bis zur Marktreife bringen können.“

Auch in Entwicklungsländern muss die KI einsetzbar sein

Mischkewitz, der vor ein paar Jahren mit Anfang 20 seine Geschäftsidee entwickelte, betont, dass es ihm nicht darum gehe, in einem Industrieland die Untersuchung eines Patienten um zehn Minuten zu beschleunigen, damit die Klinik Geld spare. Sein Ideal: Das Produkt Auto-TVT soll in Entwicklungsländern einsetzbar sein, in abgelegenen Gegenden, wo es nicht einmal Ärzte unter Zeitdruck gibt, sondern gar keine Mediziner. „Vor allem bei solchen Szenarien muss ich mir als Entwickler sehr klar machen, was schief gehen kann, was die Folgen wären und was zu tun ist, um das zu vermeiden.“

Der finanzielle Aspekt ist für ihn nicht unwichtig. „Aber es geht mir wie vielen Leuten aus meiner Generation: Das Finanzielle steht nicht an erster Stelle. Ich will ein reines Gewissen haben und mein Know-how für etwas einsetzen, hinter dem ich stehen kann.“

Manche Risiken sind nur für den Entwickler erkennbar

Gerade in der Softwareentwicklung sei die wahre Komplexität eines Systems, seine Risiken und Fehlermöglichkeiten, oft nur noch für den Programmierer selbst erkennbar. „Außenstehende können das nicht mehr beurteilen. Damit ist es aber eventuell auch die Sache des Entwicklers, das Ergebnis zu bewerten und gegebenenfalls zu sagen: So will ich das Produkt nicht weiter entwickeln, ich sehe diese und jene Risiken.“

Aber auch wenn künstliche Intelligenz den Stein ins Rollen brachte, sind beim Thema Ethik nicht nur Software-Hersteller angesprochen. Jeder Anbieter von Medizinprodukten kann damit konfrontiert sein. Zum Beispiel, wenn in ein Medizingerät eine KI integriert werden soll, um neue Funktionen zu ermöglichen.

Was macht ein Implantat aus menschlichen Empfindungen?

Wie weit die Auswirkungen gehen können und wie ambivalent ihre Einschätzung sein kann, erläutert der Ethiker Prof. Arne Manzeschke, der den Fachausschuss Medizintechnik und Gesellschaft der Deutschen Gesellschaft für Biomedizinische Technik (DGBMT) im VDE leitet. „Stellen Sie sich ein intelligentes Herzimplantat vor, das im Körper Daten misst, entsprechende Impulse abgibt und den Herzschlag bestimmt.“ Dass das technische Produkt in den physiologischen Prozess eingreift, geht weit über das bisher verbreitete Monitoring hinaus. „Aber was heißt das für den Patienten mit Implantat? Wenn wir uns erschrecken, der Puls steigt, ist das eine menschliche Empfindung. Wie aber fühlt sich der Implantatträger, dessen Puls vom Gerät beeinflusst wird? Traut er seinen Empfindungen?“ Solche Fragen müsse man in der Entwicklung stellen – und Menschen müssen vielleicht auf lange Sicht lernen, mit Technik umzugehen, die solche Effekte haben kann.

Ethische Entscheidungen fällen und verantworten können

Auch der DGBMT-Fachausschuss befürwortet eine intensivere Beschäftigung mit ethischen Fragen in der Entwicklung. Und für 2021 hat Manzeschke ein BMBF-gefördertes Projekt zur integrierten Forschung angedacht, an dem sich Wissenschaftler aus ganz Deutschland beteiligen werden. „Natürlich sind immer verschiedene Standpunkte denkbar. Aber viele Unternehmen erkennen derzeit, welche Auswirkungen Technik haben kann, wollen bestimmte – zum Beispiel militärische – Anwendungen ihrer Ideen ausschließen.“ Für die Zukunft hält es Manzeschke für wahrscheinlich, dass Ethik in Unternehmen stärker integriert wird, in Form eines Beirates, der regelmäßig zusammenkommt, oder durch externe Beratung. Aber auch die Ausbildung und Weiterbildung von Technikern könnte sich künftig wandeln. „Wir müssen Leute befähigen, über Ethik nachzudenken, Entscheidungen zu fällen und diese auch zu verantworten“, sagt Manzeschke.

Den ethischen Aspekt bei Ingenieuren besser zu verankern, sieht auch Herzog als wichtig an. In Lübeck gibt es bereits Studiengänge in den Ingenieurwissenschaften, in denen das Fach Ethik Pflicht ist. Das betrifft die Medizininformatik sowie den KI-orientierten Studiengang Robotik und autonome Systeme. Heißt konkret: Die Studierenden werden hier mit Fragen aus der Praxis konfrontiert und sollen diese beantworten helfen. Die Idee dazu stammt aus den Niederlanden.

Systems Engineering: Prozesse für Ingenieure entwickeln

„Wir wollen Ingenieuren im Sinne des Systems Engineering auch geeignete Prozesse an die Hand geben“, sagt Herzog. Kausalitäten zu visualisieren, könne helfen, die richtigen Fragen zu stellen und Ergebnisse zu dokumentieren. Auch das werde jedoch nicht dazu führen, dass Ethik per Checkliste abgehakt werden kann. „Es wird immer um eine Diskussion gehen – im Entwicklerteam oder bei Bedarf mit Vertretern betroffener Gruppen wie Ärzten, Pflegern, Patienten oder Angehörigen.“ Den Aufwand im Unternehmen müsse man aber gering halten.

Den Markt würde das vermutlich verändern: Mit zunehmendem Bewusstsein für ethische Fragen in der Gesundheitswirtschaft könnte sich der Blick der Einkäufer ändern. Und natürlich berühren ethische Fragen gerade bei Diagnose-Tools schnell haftungsrechtliche Aspekte.

Zweite Welle der Digitalisierung wird kommen – und ethische Fragen berühren

Das Thema Ethik in der Technik steht also noch am Anfang. Laut Prof. Sami Haddadin verspricht die Zukunft allerdings Entwicklungen, die zur intensiveren Beschäftigung damit führen werden. „Die erste Digitalisierungswelle haben wir hinter uns“, sagt der Münchner Forscher. Sie habe die Gesellschaft unvorbereitet getroffen und zur nachgelagerten ethischen Bewertung fertiger Technologien geführt. „Ich bin mir sicher, dass eine zweite Digitalisierungswelle folgen wird, zum Beispiel mit intelligenten cyberphysischen Systemen. Darauf sollten wir in Forschung, Industrie und Gesellschaft vorbereitet sein und entscheiden können, was wir tun wollen und was nicht.“

Weitere Informationen

Das Konzept der Embedded Ethics in Intelligent Systems haben die Münchner Forscher in einem Artikel beschrieben: www.nature.com/articles/s42256-020-0214-1

Mehr über den Ethical Innovation Hub in Lübeck: www.eih.uni-luebeck.de

Mehr über das Start-up Thinksono: www.thinksono.com

Um eine tiefe Venenthrombose festzustellen, setzt bisher der Arzt den Ultraschallkopf an. Mit der Software von Thinksono könnte das auch jemand mit wenig Erfahrung übernehmen

Um eine tiefe Venenthrombose festzustellen, setzt bisher der Arzt den Ultraschallkopf an. Mit der Software von Thinksono könnte das auch jemand mit wenig Erfahrung übernehmen(Bild: Aleksey Khripunkov/stock.adobe.com)

Über Thinksono und das Projekt Co-Co-AI

Das Start-up Thinksono hat die KI-basierte Software Auto-TVT leitet Anfänger dabei an, eine Venenuntersuchung mit Ultraschall auszuführen, um eine eventuelle tiefe Venenthrombose (TVT) nachzuweisen. Sie gibt dabei das Vorgehen Schritt für Schritt vor und liefert bei Bedarf Tipps, was der Untersuchende besser machen könnte. Das Ergebnis der Untersuchung bewertet ein erfahrener Arzt.

Anhand dieses konkreten Produktbeispiels wird im Rahmen des Projektes Co-Co-AI untersucht, welche ethischen Fragen auftauchen. Im Projekt geht es um die empirisch fundierte Entwicklung von Informations- und Kommunikationstechnologien, die eine Zusammenarbeit zwischen KI und Menschen bestmöglich unterstützen.

Betrachtet werden dabei ethische und gesellschaftliche Herausforderungen, die sich ergeben, wenn KI bestehende Strukturen – zum Beispiel im Krankenhaus – ergänzt. Methodische Grundlagen sollen erarbeitet werden, damit Patienten, Ärzte und KI-Ingenieure besser zusammenarbeiten können. KI soll erklärbar sein und moderne Mensch-Computer-Schnittstellen nutzen. Wie verantwortungsvolle Forschung und Innovation mit KI aussehen kann, sollen ethische Studien und Workshops zeigen.

Zu Co-Co-AI: http://hier.pro/wjApO

Ethik, KI und Geriatronik

In der Leuchtturminitiative „Geriatronik“ setzen die Forscher der Munich School of Robotics and Machine Intelligence (MSRM) unter Leitung von Prof. Sami Haddadin den Fokus auf Forschung für die Zukunft der Gesundheit. Der Begriff Geriatronik bezeichnet sowohl das Einsatzgebiet der Technologien – die Geriatrie, Gerontologie und medizinische Versorgung älterer Menschen – als auch die Technik selbst: Wie können Robotik, Mechatronik und Informationstechnik zum Nutzen älterer Menschen eingesetzt werden? Was können maschinelle Intelligenz und 3D-Technologie leisten?

Dabei geht es darum, möglichst genau die Sichtweise der Anwender einzunehmen. Zum Beispiel sind „offene“ Wohnungen, quasi ohne Türen, gut für Roboter, aber Senioren vermissen so gewohnte Rückzugsgebiete. Auf eine funktionierende Sprachsteuerung für ein Gerät ist der Ingenieur sicher stolz. Es stellt sich in diesem Zusammenhang aber die Frage, wie gut die Steuerung mit undeutlich gesprochenen Befehlen zurechtkommt und ob sie auch einen Dialekt versteht. Und wenn der Anspruch formuliert wird, dass ein Assistenzroboter, wie eine Pflegekraft, seine Dienste nur anbieten soll, wenn sie willkommen sind, ist das eine für die Akzeptanz wichtige Anforderung. Für den Entwickler und Programmierer aber eine echte Herausforderung.

Prof. Haddadin fasst es so zusammen: Über Ethik nachzudenken, soll zu den richtigen Fragen führen. Den richtigen Antwortkorridor zu finden, ist dann Aufgabe der Technik-Experten.

Mehr zu ethischen Fragestellungen: Interview mit dem Ethiker Prof. Arne Manzeschke