Herr Professor Juffernbruch, was fällt für Sie alles unter den Oberbegriff der „künstlichen Intelligenz“?

Sagen wir: alles, womit die menschlichen kognitiven Fähigkeiten modelliert werden können. Dazu zählen Spracherkennung, das Erkennen von Mustern, Bildern und Emotionen, aber auch die motorische Intelligenz, also die Fähigkeit, etwas zu sehen, zu greifen und zu bewegen, wie es ein Roboter tut. Da es keine allgemeingültige Definition gibt, sind die Grenzen aber nicht scharf.

Welche Vorteile kann künstliche Intelligenz im Gesundheitsbereich bieten?

Bei der Bilderkennung ist heute schon klar, dass Systeme mit künstlicher Intelligenz schneller sind als Menschen und weniger Fehler machen. Also ließe sich damit die Qualität der Diagnose verbessern. Um Diagnose geht es auch bei Patienten mit seltenen Krankheiten, die heute oft eine Odyssee hinter sich bringen müssen, bis sie einen Arzt treffen, der die Symptome richtig deutet. Mit KI-Systemen wäre das gesamte aktuelle medizinische Wissen in jeder Hausarztpraxis verfügbar. Dort könnte das, was die KI liefert, wie die Zweitmeinung eines Arztes genutzt werden. Ich gehe davon aus, dass wir so etwas in einigen Jahren haben und es vor Gericht als Kunstfehler gelten wird, wenn ein Arzt diese Möglichkeit nicht nutzt. Ein weiterer Punkt ist der Arztmangel, vor allem in ländlichen Gegenden.

Welche Aufgaben eines Arztes könnte KI übernehmen?

Ein Gerät mit KI, das nicht-invasiv Parameter misst, könnte einem Patienten Hinweise zu seinem Gesundheitszustand geben, ihn also entweder beruhigen, wenn harmlose Symptome auftreten, oder ihm einen baldigen Arztbesuch empfehlen. Das würde nicht nur die Praxen entlasten, sondern auch die Notaufnahmen in den Krankenhäusern. Dorthin wenden sich oft Patienten, die nicht mehr haben als einen Schnupfen.

Wie sehr kann man sich auf Systeme mit künstlicher Intelligenz verlassen?

Um das zu beantworten, muss man sich darüber im Klaren sein, dass es zwei Arten künstlicher Intelligenz gibt. Die eine folgt festen Regeln, also einem Entscheidungsbaum, wie man ihn im Studium lernt. Symptom A in Kombination mit B deutet auf die Erkrankung X hin. Wenn Symptom C hinzukommt, ist aber Krankheit Y wahrscheinlicher. Ein System, das so arbeitet, kann den Arzt unterstützen, und er kann das Ergebnis Schritt für Schritt nachvollziehen. Aufgaben wie eine Mustererkennung auf einem Röntgenbild lassen sich damit allerdings kaum lösen. Hierfür wird künstliche Intelligenz gebraucht, die nach dem zweiten Prinzip arbeitet und neuronale Netze nutzt.

Was macht KI, die neuronale Netze nutzt, anders?

Hier trainieren Entwickler das System anhand von Beispielen, und das System generiert Regeln. Es kommt also im ersten Schritt vielleicht zu Ergebnis X, erhält aber dann den Input, dass X falsch und Y richtig gewesen wäre. Mit so einem Training verändern sich Verknüpfungen im System. Nach einiger Zeit lässt sich nicht mehr nachvollziehen, auf welchem Weg ein Ergebnis erreicht wurde. Zumindest gibt es bisher keine Technik dafür. Das ist im menschlichen Gehirn übrigens nicht grundsätzlich anders, und da nennen wir das Intuition.

Würden Sie einem solchen System

vertrauen?

Wenn wir künstliche Intelligenz im Gesundheitswesen nutzen wollen, müssen wir ihre Qualität sichern – auch wenn wir den Weg nicht nachvollziehen können, auf dem das System zum Ergebnis kam. Noch ist die Technik so neu, dass es für die Qualitätssicherung keine etablierten Regeln gibt. Wer eine Idee hat, macht eine Studie, vergleicht mit den Rückschlüssen von vier, zehn oder mehr Medizinern, ganz wie es ihm beliebt. Wir bräuchten aber einheitliche Kriterien, mit denen die Leistungsfähigkeit geprüft wird. Meiner Meinung nach wäre eine Art Facharztprüfung für Systeme mit künstlicher Intelligenz ein geeigneter Weg, die Qualität zu sichern. Aber um die Frage zu beantworten: Wenn ein System zuverlässig geprüft wäre, würde ich ihm vertrauen.

Welche Risiken bringt künstliche Intelligenz eventuell mit sich?

Das lässt sich wieder am Beispiel eines Gerätes für die Bildgebung erläutern. Enthält das System neuronale Netze, wurde es beim Hersteller trainiert und als Medizinprodukt zugelassen. In die Krankenhäuser kommt es also in einem bestimmten Zustand. Wenn die Möglichkeit zum Training des Systems aktiv ist, wird es sich in der folgenden Zeit verändern: In Abhängigkeit von den Fähigkeiten der Radiologen, die damit arbeiten, wird sich die Fehlerquote des Systems beim Interpretieren der Bilddaten also verbessern oder verschlechtern. Das ist dann weder für den Betreiber noch für den Hersteller nachvollziehbar. Daher wäre aus meiner Ansicht zu fordern, dass ein KI-System in dem gut trainierten Originalzustand verbleibt, in dem der Hersteller es liefert.

Wie groß ist die Gefahr durch einen Missbrauch von Daten?

Im professionellen Umfeld macht mir das keine Sorgen. Ich gebe ja auch meine Blutprobe zur Untersuchung ins Labor, und dort werden Daten nach bestimmten Regeln erhoben und verarbeitet. Man könnte allerdings auch eine KI in einem professionellen Gerät so trainieren, dass sie Ergebnisse im Sinne des Anbieters liefert – also ein bestimmtes Medikament empfiehlt oder zu einer Operation rät. Da ist Vorsicht geboten. Schwierig wird es, wenn Anbieter kostenlose Gesundheitsservices anbieten und dabei Daten erheben. Wenn der Patient diese freiwillig abgibt – und viele sind bereit dazu –, ist die Nutzung nicht strafbar. Aber dann sollte zumindest transparent sein, was mit den Daten passiert. Dass es Anbieter geben wird, die Daten zu illegalen Zwecken sammeln, ist nicht auszuschließen, so wie es bereits bei Social Media war.

Wird künstliche Intelligenz in der

Medizin schon genutzt?

Die Technik steht noch am Anfang, aber es gibt vereinzelte Anwendungen, die den Sprung aus der Forschung zum Produkt geschafft haben.

Was sind die größten Hindernisse für die Nutzung künstlicher Intelligenz?

Systeme mit künstlicher Intelligenz zu entwickeln, lohnt sich nur, wenn es am Ende eine angemessene Vergütung dafür gibt. Da sind wir gerade in Deutschland noch nicht weit genug. Es gibt eine Lobby, die die althergebrachten Geschäftsmodelle erhalten möchte, und so kommen viele digitalisierte Modelle nicht in die Regelversorgung, selbst wenn sie den Patienten nachweislich Vorteile bringen. Und wir brauchen hier mehr Venture Capital, um die Entwicklungen voranzubringen.

Wie wird KI das Gesundheitswesen bis 2030 verändern?

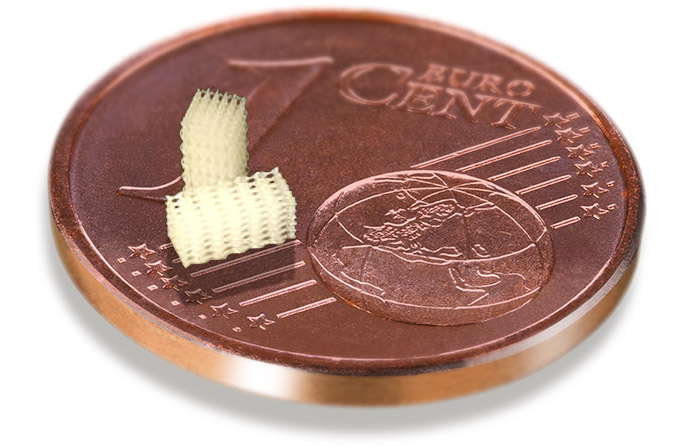

Insbesondere in der Bildgebung werden wir viel mehr künstliche Intelligenz einsetzen. Das Interesse der Verbraucher an kleinen handlichen Geräten, die Daten zur Gesundheit messen und auswerten, wird wachsen. Und ich persönlich hoffe, dass so etwas wie ein Tricorder nach dem Vorbild von Raumschiff Enterprise auf den Markt kommt, der mir sagt, wenn ich zum Arzt gehen sollte. Technisch ist so etwas in Anfängen schon machbar.

Über die Expertengruppe Intelligente

Gesundheitsnetze: http://hier.pro/enAlw