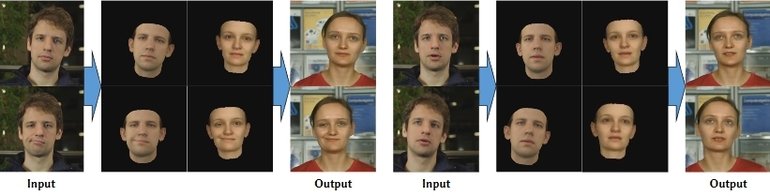

Was ist, wenn man etwas erforscht, was eine große Vereinfachung mit sich bringt – und gleichzeitig ein großes Missbrauchspotenzial? Diese Frage musste sich ein internationales Team aus Forschern des Max-Planck-Instituts für Informatik, Saarbrücken, der TU München, der University of Bath, Technicolor und der Stanford University stellen. Denn sie entwickelten eine Software, mit der Lippenbewegung, Kopfhaltung, ja die ganze Mimik von Schauspielern in Spielfilmen verändert werden kann – ohne, dass es jemand merkt. Der Vorteil: Bei Synchronisationen von Spielfilmen stimmen dank der Software endlich die Sprache und die Lippenbewegung überein. Dazu kann der Deep Video Portraits genannte Ansatz das gesamte Gesicht animieren und sogar einen plausiblen statischen Videohintergrund synthetisieren, wenn der Kopf bewegt wird.

Die gefilmte Geschichte anders erzählen

Ein weiterer Vorteil: Der Aufwand für einen Film wie „Der seltsame Fall des Benjamin Button“, in dem das Gesicht von Brad Pitt in fast jedem Frame des Films durch eine modifizierte Computergrafikversion ersetzt wurde, wäre mit der neuen Software deutlich einfacher und schneller. „Mit unserem Ansatz können sogar die Platzierung des Kopfes des Schauspielers und sein Gesichtsausdruck problemlos verändert werden, um den Kamerawinkel zu ändern oder den Rahmen einer Szene subtil zu verändern, um die Geschichte besser zu erzählen“, erklärt Dr. Christian Richardt, Co-Autor des Beitrags, vom Motion-Capture-Forschungszentrum CAMERA der University of Bath.

Und noch ein Vorteil: Auch für Videokonferenzen ließe sich der Ansatz nutzen – um Kopf- und Blickbewegung des Gegenübers so zu verändern, dass eine natürlichere Gesprächssituation erreicht wird.

Es gibt ein großes Missbrauchspotenzial

Doch der große Nachteil ist: Es gibt ein großes Missbrauchspotenzial. Aufnahmen von Menschen können nach Belieben verändert werden. In Zeiten von Fake News eine gruselige Vorstellung.

Die Wissenschaftler wählten daher einen ungewöhnlichen Weg: Sie veröffentlichten zwar, dass es dieses Verfahren nun gibt, halten die Software aber unter Verschluss – und entwickeln mit ihrer Hilfe lieber erst noch einen möglichen Schutz: Neuronale Netze, die darauf trainiert sind, synthetisch erzeugte oder bearbeitete Videos mit hoher Präzision zu detektieren; Fälschungen ließen sich dadurch viel leichter erkennen.

Videoinhalte kritischer betrachten

Gefahr gebannt? Nicht ganz, auch wenn die Autoren die Software noch nicht öffentlich zugänglich machen, wird diese Technik beizeiten einen Weg in den Markt finden. Die Wissenschaftler gehen daher davon aus, dass dieser Ansatz Teile der visuellen Unterhaltungsindustrie massiv verändern könnte. Und dass wir künftig die Videoinhalte, die wir täglich konsumieren, kritischer betrachten sollten, insbesondere wenn es keinen Herkunftsnachweis gibt. Sie schlagen daher vor, dass jede Software, die solche kreativen Anwendungsfälle implementiert, Wasserzeichen enthalten sollte, um Änderungen klar zu kennzeichnen.

Noch gibt es diese Wasserzeichen nicht, uns bleibt nichts anderes übrig als nun auch Videos etwas kritischer auf Quellen zu prüfen. Zurückdrehen lässt sich die Erfindung nicht. Die Geister, die wir riefen, werden wir nicht wieder los – mit oder ohne Wasserzeichen.

www.youtube.com/watch?v=qc5P2bvfl44

https://s2018.siggraph.org/presentation/?id=papers_129&sess=sess146